この時代において、Transformers は複数の NLP (自然言語処理) 操作で最高の結果を提供する最も強力なモデルです。当初は、テキスト生成、分類、機械翻訳などを含む言語モデリング タスクに利用されていました。しかし現在では、物体認識、画像分類、その他複数のコンピューター ビジョン タスクにも使用されています。

このチュートリアルでは、Transformers を使用してテキスト分類を実行する手順を説明します。

トランスフォーマーを使用してテキスト分類を実行するにはどうすればよいですか?

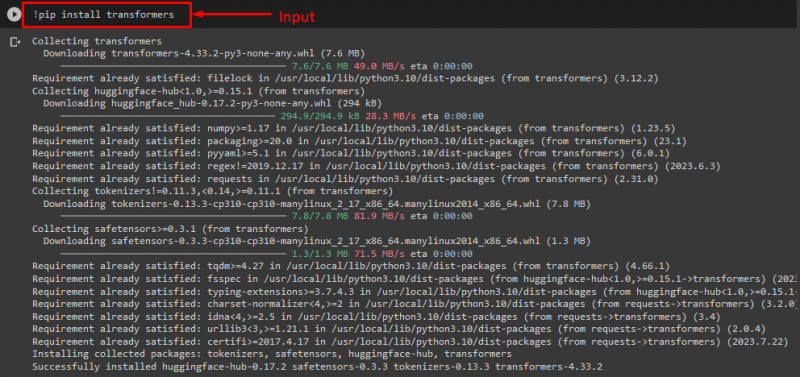

Transformers を使用してテキスト分類を実行するには、まず、「 変圧器 提供されたコマンドを実行して、ライブラリを開きます。

! ピップ インストール 変圧器

ご覧のとおり、指定されたライブラリは正常にインストールされました。

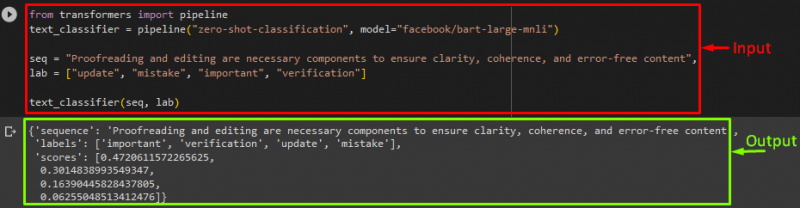

次に、「」をインポートします。 パイプライン ' から ' 変圧器 ' 図書館:

変圧器からのインポートパイプライン

ここで、「 パイプライン 」には、実行する必要がある NLP タスクと、この操作に必要なトランスフォーマー モデルとトークナイザーが含まれます。

注記: トークナイザーは、テキストをトークンに分割することにより、モデルの入力に提供されるテキストの処理を実行するために使用されます。

その後、「」を使用します。 パイプライン() ” 関数を作成し、それに渡す” ゼロショット分類 」という議論があります。次に、モデルである別のパラメータを渡します。 Facebookの「」を利用しております。 バート 』トランスモデル。ここでは、トークナイザーは指定されたモデルによって自動的に推論できるため、使用しません。

text_classifier = パイプライン ( 「ゼロショット分類」 、 モデル = 「フェイスブック/バート-ラージ-mnli」 )

さあ、「」を宣言してください。 連続 」 分類する必要がある入力テキストを保持する変数。次に、テキストを分類して「」に保存するカテゴリを指定します。 研究室 ” これはラベルとして知られています。

研究室 = [ 'アップデート' 、 '間違い' 、 '重要' 、 '検証' ]

最後に、入力とともにパイプラインを実行します。

パイプラインを実行した後、モデルは、提供されたシーケンスが分類されると予測したことがわかります。

追加情報: モデルのパフォーマンスを高速化したい場合は、GPU を使用する必要があります。 「はい」の場合、その目的のためにパイプラインにデバイス引数を指定し、それを「」に設定できます。 0 」を使用してGPUを活用します。

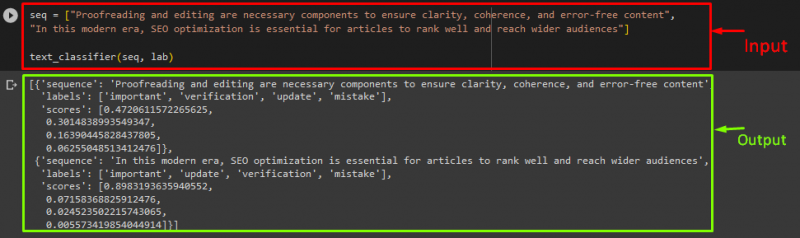

複数のシーケンス/入力テキスト ステートメントのテキストを分類する場合は、それらをリストに追加し、入力としてパイプラインに渡すことができます。そのためには、コード スニペットを確認してください。

連続 = [ 「校正と編集は、内容の明瞭さ、一貫性、エラーのないことを保証するために必要な要素です。」 、「現代では、記事を上位にランク付けし、より多くの読者にリーチするには、SEO の最適化が不可欠です。」 】

テキスト分類子 ( 連続 、研究室 )

出力

それでおしまい! Transformers を使用してテキスト分類を実行する最も簡単な方法をまとめました。

結論

トランスフォーマーは、テキスト生成、テキスト分類、機械翻訳などの言語モデリング タスクと、オブジェクト認識や画像分類などのコンピューター ビジョン タスクを実行するために使用されます。このチュートリアルでは、Transformers を使用してテキスト分類を実行するプロセスを説明しました。