LangChain は、人間に似た言語でモデルを構築するための、自然言語処理または NLP ドメインのアプリケーションを備えたフレームワークです。人間はこれらのモデルを使用して、モデルから回答を得たり、他の人間と同じように会話したりできます。 LangChain は、会話内の各文を保存し、それをコンテキストとして使用してさらに対話することでチェーンを構築するために使用されます。

この投稿では、LangChain で LLM と LLMChain を構築するプロセスを説明します。

LangChain で LLM と LLMChain を構築するにはどうすればよいですか?

LangChain で LLM と LLMChain を構築するには、以下の手順を実行するだけです。

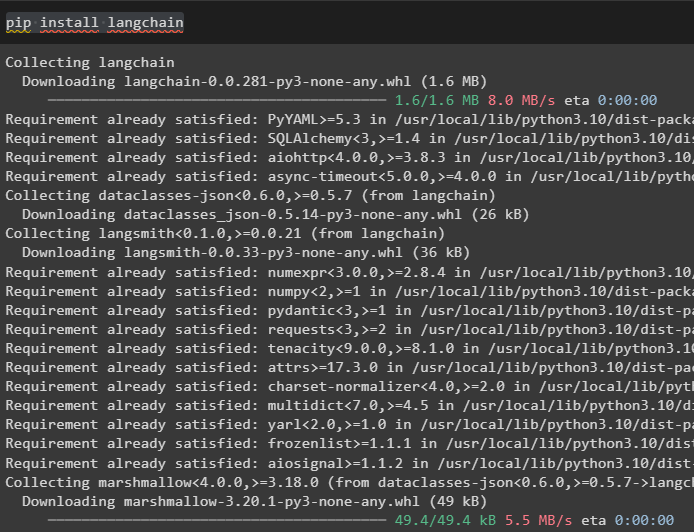

ステップ 1: モジュールをインストールする

まず、LangChain モジュールをインストールして、そのライブラリを使用して LLM と LLMChain を構築します。

pip インストール ラングチェーン

LLM の構築に必要なもう 1 つのモジュールは OpenAI で、pip コマンドを使用してインストールできます。

pip インストール openai

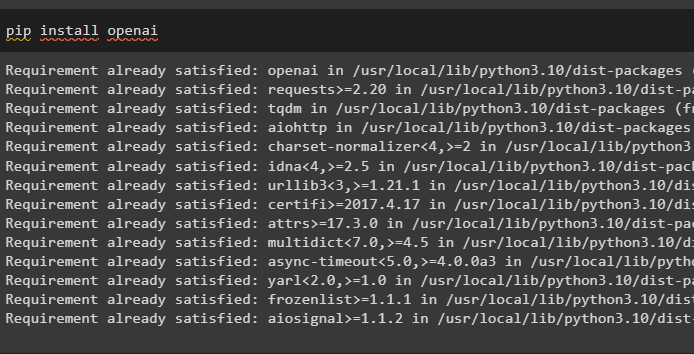

ステップ 2: 環境をセットアップする

環境の OpenAI API キーを使用して環境をセットアップします。

私たちを輸入してくださいimport getpassos.environ['OPENAI_API_KEY'] = getpass.getpass('OpenAI API キー:')

例 1: LangChain を使用して LLM を構築する

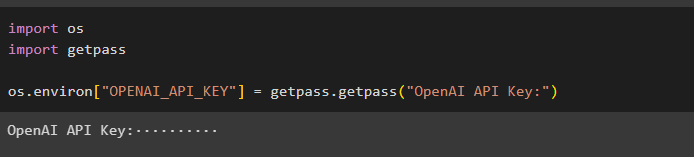

最初の例は、OpenAI および ChatOpenAI ライブラリをインポートし、llm() 関数を使用して、LangChain を使用して大規模言語モデルを構築することです。

ステップ 1: LLM チャット モデルの使用

OpenAI および ChatOpenAI モジュールをインポートして、LangChain から OpenAI 環境を使用して単純な LLM を構築します。

langchain.chat_models から ChatOpenAI をインポートlangchain.llms から OpenAI をインポート

llm = OpenAI()

chat_model = ChatOpenAI()

llm.predict('こんにちは!')

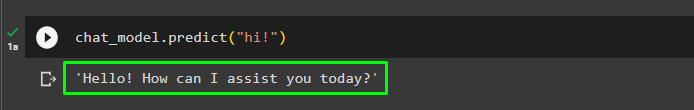

以下のスクリーンショットに示すように、モデルは「こんにちは」という応答を返しました。

chat_model の detect() 関数は、モデルから回答または応答を取得するために使用されます。

chat_model.predict('こんにちは!')出力には、クエリを行うユーザーがモデルを自由に使用できることが表示されます。

ステップ 2: テキスト クエリを使用する

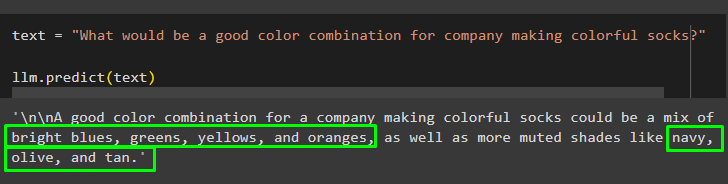

ユーザーは、テキスト変数に完全な文を入力することで、モデルから回答を取得することもできます。

text = 'カラフルな靴下を製造する会社にふさわしい社名は何でしょうか?'llm.predict(テキスト)

モデルは、カラフルな靴下の複数の色の組み合わせを表示しました。

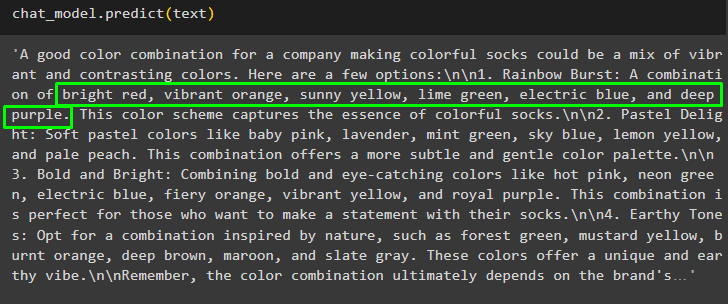

靴下の色の組み合わせを指定して、predict() 関数を使用してモデルから詳細な応答を取得します。

chat_model.predict(テキスト)

ステップ 3: コンテンツにテキストを使用する

ユーザーは、答えについての簡単な説明を加えて答えを得ることができます。

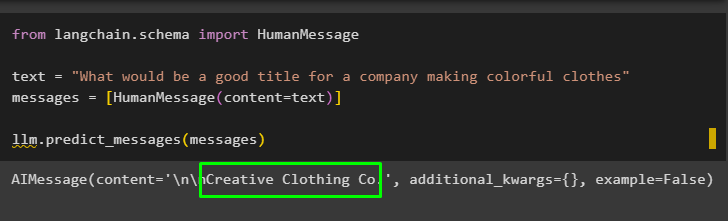

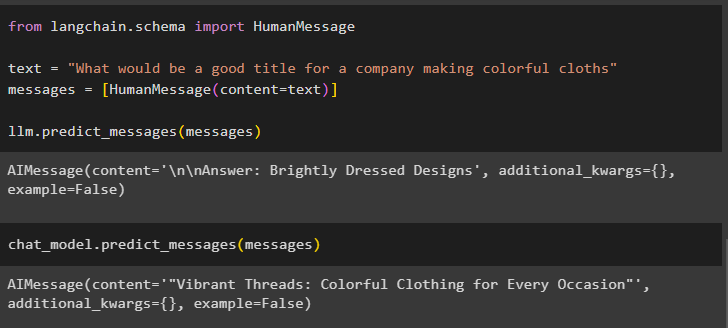

langchain.schema から HumanMessage をインポートtext = 'カラフルな服を作っている会社にぴったりのタイトルは何でしょう'

メッセージ = [HumanMessage(content=text)]

llm.predict_messages(メッセージ)

モデルは、「Creative Clothing Co」という会社のタイトルを生成しました。

メッセージを予測して、会社のタイトルの答えとその説明を取得します。

chat_model.predict_messages(メッセージ)

例 2: LangChain を使用して LLMChain を構築する

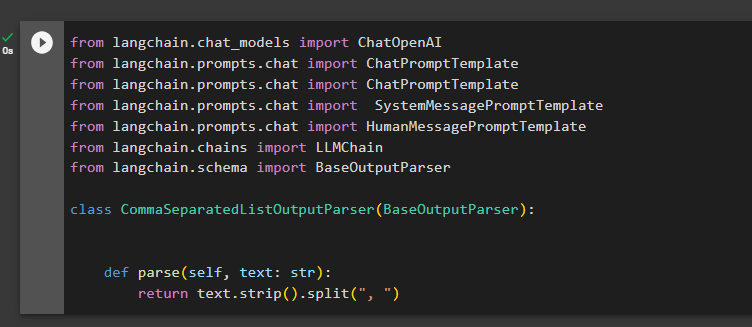

ガイドの 2 番目の例では、LLMChain を構築して人間の対話形式でモデルを取得し、前の例のすべての手順を結合します。

langchain.chat_models から ChatOpenAI をインポートlangchain.prompts.chat から ChatPromptTemplate をインポート

langchain.prompts.chat から ChatPromptTemplate をインポート

langchain.prompts.chat からインポート SystemMessagePromptTemplate langchain.prompts.chat からインポート HumanMessagePromptTemplate

langchain.chains から LLMChain をインポート

langchain.schema からのインポート BaseOutputParserclass CommaSeparatedListOutputParser(BaseOutputParser):

def parse(self, text: str):

return text.strip().split(', ')

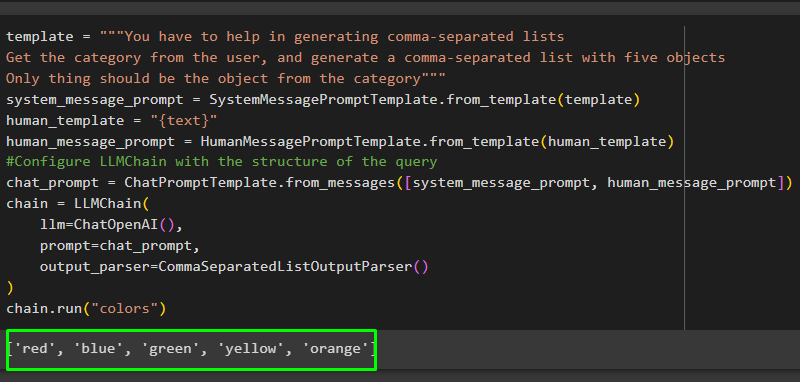

チャット モデルの動作の詳細な説明を提供してチャット モデルのテンプレートを構築し、LLM、出力パーサー、および chat_prompt ライブラリを含む LLMChain() 関数を構築します。

template = '''カンマ区切りリストの生成を手伝ってもらう必要がありますユーザーからカテゴリを取得し、5 つのオブジェクトを含むカンマ区切りのリストを生成します。

カテゴリ「」のオブジェクトのみである必要があります。

system_message_prompt = SystemMessagePromptTemplate.from_template(テンプレート)

human_template = '{テキスト}'

human_message_prompt = HumanMessagePromptTemplate.from_template(human_template)

#クエリの構造を使用して LLMChain を構成します

chat_prompt = ChatPromptTemplate.from_messages([system_message_prompt, human_message_prompt])

チェーン = LLMChain(

llm=ChatOpenAI(),

プロンプト=チャット_プロンプト、

Output_parser=CommaSeparatedListOutputParser()

)

chain.run('カラー')

カテゴリにはプロンプトで指定された 5 つのオブジェクトのみを含める必要があるため、モデルは色のリストを含む答えを提供しました。

LangChain で LLM と LLMChain を構築する方法は以上です。

結論

LangChain を使用して LLM および LLMChain を構築するには、LangChain および OpenAI モジュールをインストールし、その API キーを使用して環境をセットアップするだけです。その後、完全なチャットに対する単一のクエリのプロンプト テンプレートを作成した後、chat_model を使用して LLM モデルを構築します。 LLMChain は、会話内のすべての観察のチェーンを構築し、それらを対話のコンテキストとして使用するために使用されます。この投稿では、LangChain フレームワークを使用して LLM と LLMChain を構築するプロセスを説明します。