このブログでは、PyTorch で GPU 使用率を高める方法に焦点を当てます。

PyTorch で GPU 使用率を高めるにはどうすればよいですか?

GPU 使用率を高め、複雑な機械学習モデルの処理に最適なハードウェア リソースが確実に使用されるようにするために使用できる手法がいくつかあります。これらの戦術には、コードの編集と PyTorch 機能の利用が含まれます。いくつかの重要なヒントとコツを以下に示します。

データのロードとバッチサイズ

” データローダー PyTorch の「」は、深層学習モデルの各前方パスでプロセッサにロードされるデータの仕様を定義するために使用されます。より大きな「」 バッチサイズ 」のデータを処理するには、より多くの処理能力が必要となり、利用可能な GPU の使用率が増加します。

PyTorch で特定のバッチ サイズを持つデータローダーをカスタム変数に割り当てるための構文は次のとおりです。

Increase_GPU_Utilization = データローダー ( バッチサイズ = 32 )

メモリ依存度の低いモデル

モデル アーキテクチャごとに必要な量は異なります。 メモリ 」を最適なレベルで実行します。単位時間当たりのメモリ使用量が少なく効率的なモデルは、他のモデルよりもはるかに大きなバッチ サイズで動作できます。

PyTorch ライトニング

PyTorch には、「 PyTorch ライトニング ”。その名前からわかるように、超高速のパフォーマンスを実現するために最適化されています。 Lightning はデフォルトで GPU を使用し、機械学習モデルの処理を大幅に高速化します。 Lightning の主な利点は、処理を妨げる定型コードが必要ないことです。

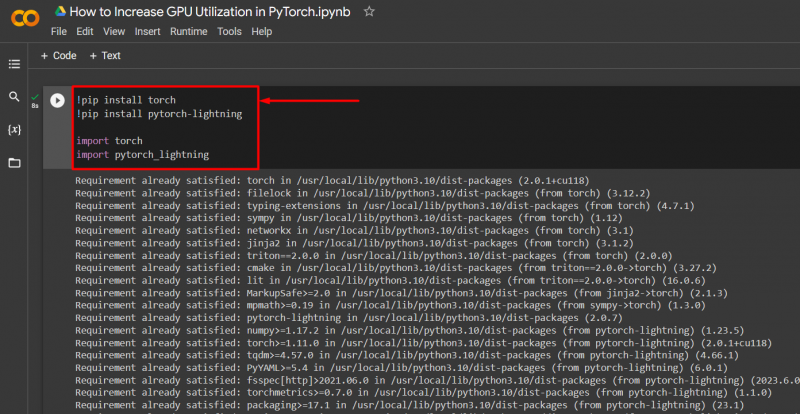

以下の構文を使用して、必要なライブラリを PyTorch プロジェクトにインポートします。

! pip インストールトーチ

! pip インストール pytorch - 稲妻

輸入 松明

輸入 pytorch_lightning

Google Colab でランタイム設定を調整する

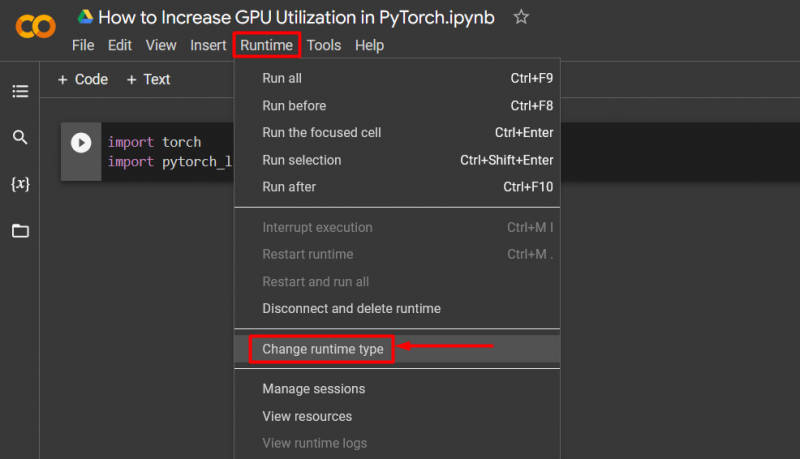

Google Colaboratory は、PyTorch モデルの開発のためにユーザーに無料の GPU アクセスを提供するクラウド IDE です。デフォルトでは、Colab プロジェクトは CPU で実行されますが、設定は変更できます。

Colab ノートブックを開き、「 ランタイム メニューバーの「」オプションを選択し、「」までスクロールダウンします。 ランタイム設定を変更する ”:

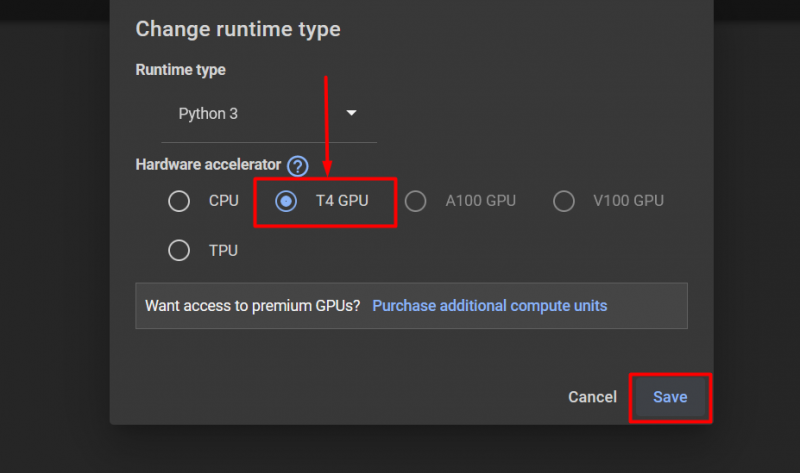

次に、 「T4 GPU」 オプションを選択して「」をクリックします 保存 」を実行して、GPU を利用するための変更を適用します。

最適化のためのキャッシュのクリア

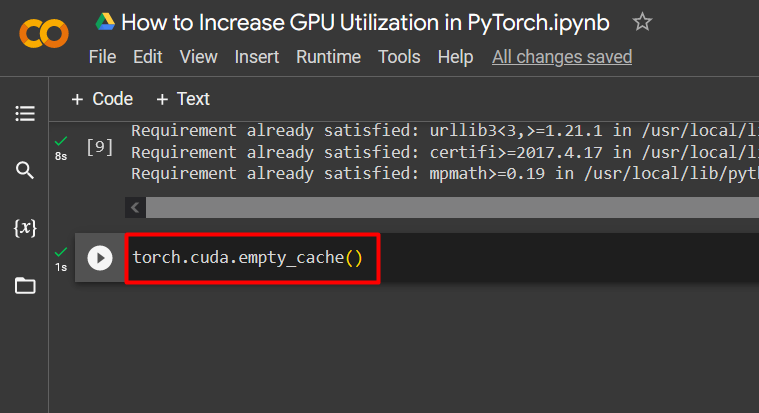

PyTorch を使用すると、ユーザーはメモリ キャッシュをクリアして、新しいプロセスを実行するためのスペースを確保できます。 ” キャッシュ 」は、実行中のモデルに関するデータと情報を保存するため、これらのモデルのリロードにかかる時間を節約できます。キャッシュをクリアすると、新しいモデルを実行するためのより多くのスペースがユーザーに提供されます。

GPU キャッシュをクリアするコマンドは次のとおりです。

松明。 違う 。 空のキャッシュ ( )

これらのヒントは、PyTorch の GPU を使用した機械学習モデルの実行を最適化するために使用されます。

プロのヒント

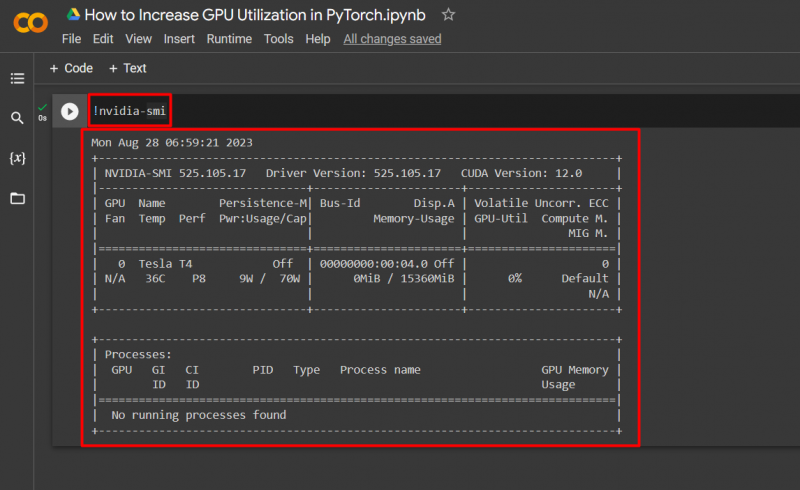

Google Colab では、ユーザーが「」によって GPU 使用率の詳細にアクセスできるようになります。 エヌビディア 」を使用して、ハードウェア リソースが使用されている場所に関する情報を取得します。 GPU 使用率の詳細を表示するコマンドを以下に示します。

! エヌビディア - スミ

成功! PyTorch で GPU 使用率を高めるいくつかの方法を説明しました。

結論

キャッシュの削除、PyTorch Lightning の使用、ランタイム設定の調整、効率的なモデルの使用、および最適なバッチ サイズにより、PyTorch での GPU 使用率を高めます。これらの手法は、深層学習モデルが最高のパフォーマンスを発揮し、利用可能なデータから有効な結論と推論を引き出すことができるようにするのに大いに役立ちます。 GPU 使用率を高める手法を実証しました。