このガイドでは、LangChain Hub からチェーンをロードするプロセスを説明します。

LangChainを使用してチェーンにメモリ状態を追加するにはどうすればよいですか?

メモリ状態は、出力を返すときに使用されるチェーンに格納されている最近の値を参照できるため、チェーンを初期化するために使用できます。 LangChain フレームワークを使用してメモリ状態をチェーンに追加するプロセスを学ぶには、次の簡単なガイドを参照してください。

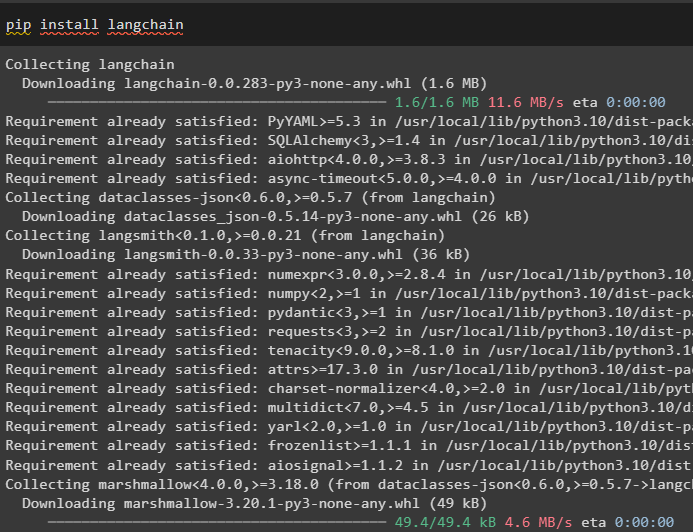

ステップ 1: モジュールをインストールする

まず、pip コマンドを使用して、LangChain フレームワークとその依存関係をインストールし、プロセスを開始します。

pip インストール ラングチェーン

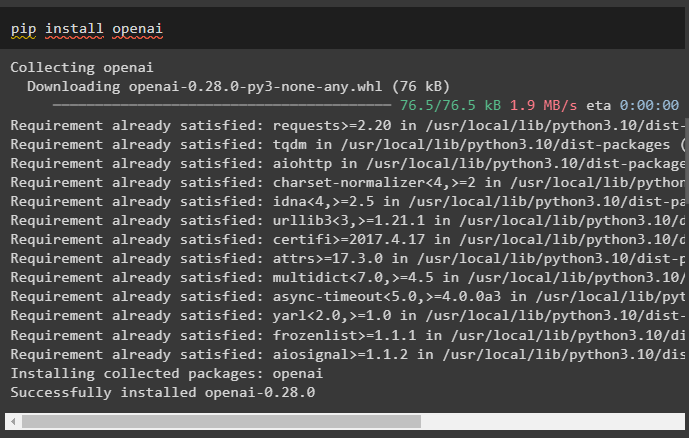

OpenAI モジュールもインストールして、チェーンにメモリ状態を追加するために使用できるライブラリを取得します。

pip インストール openai

OpenAIアカウントからAPIキーを取得し、 環境をセットアップする それを使用して、チェーンがアクセスできるようにします。

輸入 あなた

輸入 ゲットパス

あなた 。 約 [ 「OPENAI_API_KEY」 】 = ゲットパス 。 ゲットパス ( 「OpenAI API キー:」 )

このステップは、コードが適切に動作するために重要です。

ステップ 2: ライブラリをインポートする

環境をセットアップしたら、LLMChain、ConversationBufferMemory などのメモリ状態を追加するためのライブラリをインポートするだけです。

から ラングチェーン。 鎖 輸入 会話チェーンから ラングチェーン。 メモリ 輸入 会話バッファメモリ

から ラングチェーン。 チャットモデル 輸入 チャットオープンAI

から ラングチェーン。 鎖 。 llm 輸入 LLMチェーン

から ラングチェーン。 プロンプト 輸入 プロンプトテンプレート

ステップ 3: チェーンの構築

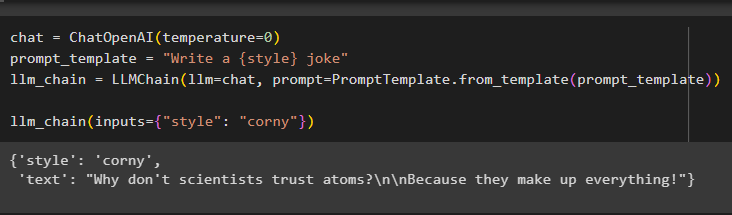

ここで、OpenAI() メソッドと、チェーンを呼び出すクエリを使用するプロンプトのテンプレートを使用して、LLM のチェーンを構築するだけです。

チャット = チャットオープンAI ( 温度 = 0 )プロンプト_テンプレート = 「{style} のジョークを書いてください」

llm_chain = LLMチェーン ( llm = チャット 、 プロンプト = プロンプトテンプレート。 from_template ( プロンプト_テンプレート ) )

llm_chain ( 入力 = { 'スタイル' : 「陳腐な」 } )

以下のスクリーンショットに示すように、モデルには LLM モデルを使用した出力が表示されています。

ステップ 4: メモリ状態の追加

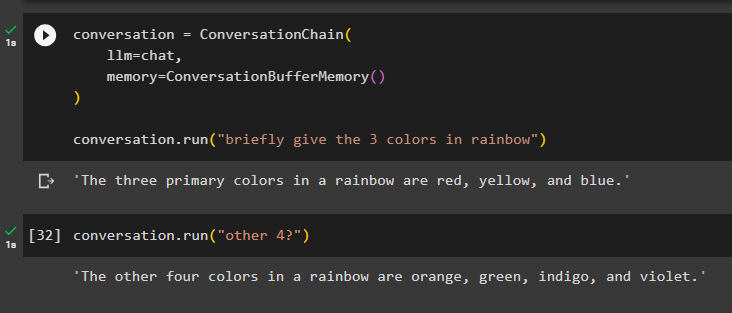

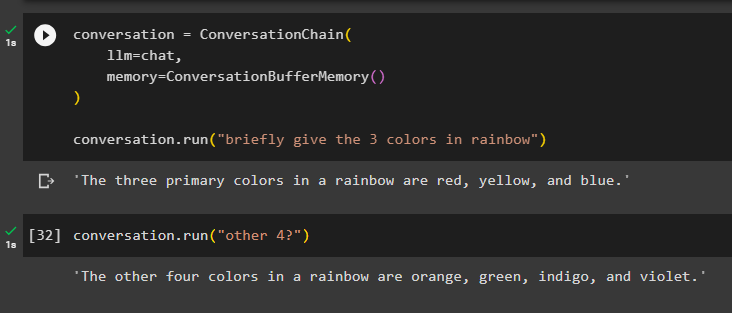

ここでは、ConversationBufferMemory() メソッドを使用してチェーンにメモリ状態を追加し、チェーンを実行して虹から 3 色を取得します。

会話 = 会話チェーン (llm = チャット 、

メモリ = 会話バッファメモリ ( )

)

会話。 走る ( 「虹の3色を簡単に教えてください」 )

モデルは虹の 3 色のみを表示しており、コンテキストはチェーンのメモリに保存されています。

ここでは、「」というあいまいなコマンドを使用してチェーンを実行しています。 他の4つは? 」 したがって、モデル自体がメモリからコンテキストを取得し、残りの虹色を表示します。

会話。 走る ( 「他の4人は?」 )モデルはコンテキストを理解し、虹セットから残りの 4 色を返したので、まさにそれを実行しました。

LangChain Hub からチェーンをロードする方法は以上です。

結論

LangChain フレームワークを使用してメモリをチェーンに追加するには、モジュールをインストールして LLM を構築するための環境をセットアップするだけです。その後、LLM でチェーンを構築するために必要なライブラリをインポートし、それにメモリ状態を追加します。メモリ状態をチェーンに追加した後、単にチェーンにコマンドを発行して出力を取得し、次に前のコマンドのコンテキスト内で別のコマンドを発行して正しい応答を取得します。この投稿では、LangChain フレームワークを使用してチェーンにメモリ状態を追加するプロセスについて詳しく説明しました。